OpenAIのGPT Image 2は、画像生成機能の最新バージョンであり、GPT-4oモデルファミリーに直接統合されています。AIエージェントのワークフローにおける画像生成を追ってきた開発者にとって、これは重要な進展です——必ずしも最高の画像生成ツールというわけではありませんが、画像生成をAI推論パイプラインに組み込む方法を大きく変えるものだからです。

GPT Image 2とは?

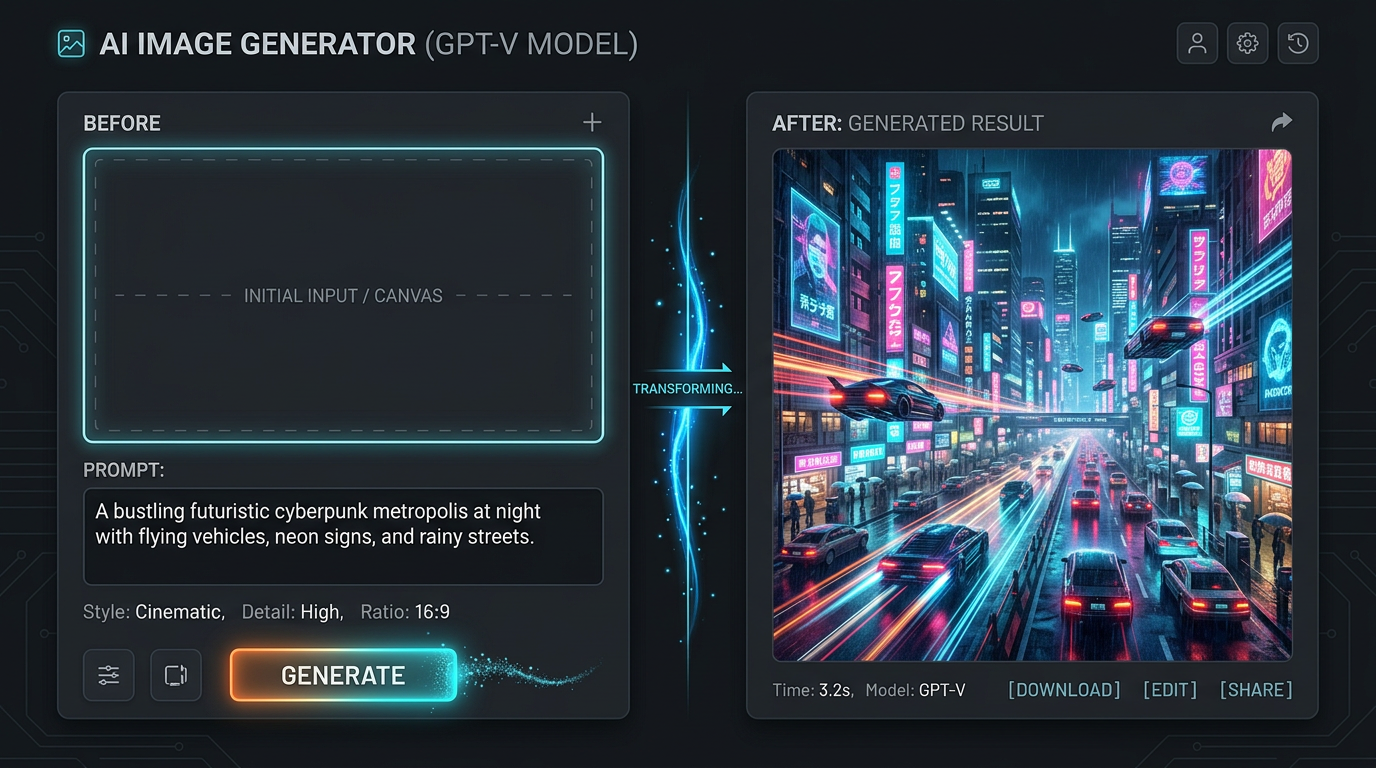

GPT Image 2は、GPT-4oに組み込まれたOpenAIのマルチモーダル画像生成機能です。DALL-E 3(別途APIコールが必要でした)とは異なり、GPT Image 2はチャットやAPI会話の中でネイティブに画像を生成します——モデルが画像について推論し、フォローアップの指示に基づいて修正し、視覚的な出力を推論プロセスに統合することができます。

主な特徴:

- ネイティブマルチモーダル: 会話の一部として機能し、別途呼び出し不要

- 指示への追従: 複雑で詳細なプロンプトを前世代より正確に処理

- テキストレンダリング: 画像内のテキスト品質が大幅に向上(長年の弱点)

- 編集機能: 同一会話内での反復的な改善をサポート

GPT Image 2 vs. 他モデル:現在地

| モデル | 強み | 弱み |

|---|---|---|

| GPT Image 2 | テキストレンダリング、指示への追従、推論統合 | アート表現の幅が狭い、コストが高い |

| Nano Banana 2 | スピード、開発者API、多様なスタイル | 会話統合が弱い |

| Stable Diffusion (SDXL) | ファインチューニング、ローカル展開 | 複雑なセットアップ、指示への追従が弱い |

| Midjourney | 芸術的品質、美的な出力 | APIなし、開発者向けでない |

| Ideogram | 画像内の文字・タイポグラフィ | 用途が限定的 |

GPT Image 2の最大の強みは推論との統合です:GPT-4oエージェントが画像を生成し、同じ推論チェーン内でそれを評価し、修正するかどうかを決定できます——会話のコンテキストを離れることなく。

開発者向けAPIアクセス

GPT Image 2は、GPT-4oへのアクセス権を持つユーザー向けにOpenAI APIで利用可能です:

from openai import OpenAI

client = OpenAI()

# GPT Image 2で画像を生成する

response = client.chat.completions.create(

model="gpt-4o",

messages=[{

"role": "user",

"content": "Generate an image of a minimal developer dashboard UI, dark theme, with metrics displayed"

}],

# 画像生成はモデルがネイティブに処理

)

注意: GPT Image 2の正確なAPIパラメータは、本稿執筆時点でもドキュメント化が進行中です。最新情報はOpenAIデベロッパーポータルをご確認ください。

料金に関する考慮事項

GPT Image 2はGPT-4oのトークン使用量の一部として課金されます:

- 画像入力は入力トークンとして課金(画像サイズ・詳細度に応じて)

- 画像生成の出力はテキスト出力より高コスト

- 1枚あたりの実際のコストは専用画像生成APIより高め

目安: パイプラインで大量の画像を生成する場合は、専用画像モデル(nano-banana、Stable Diffusion)の方がコスト効率が高くなります。GPT Image 2の価値は、画像がより大きなチェーンの一部となる推論ワークフローにあり、大量生成向きではありません。

GPT Image 2が特に優れるユースケース

1. ビジュアルを組み込んだドキュメント・レポート生成 レポートを作成しながら、データを正確に表現しているかを評価しつつ、グラフや図表も生成するエージェント。

2. 反復的な改善を伴うUIプロトタイピング 「ログインフォームのデザインを生成して」→「ボタンをもっと目立たせて」→「ダークモード版を追加して」——すべて1つの会話内で完結、コンテキスト切り替え不要。

3. 正確なテキスト要件が求められるコンテンツ SNSグラフィック、スライド、マーケティング素材など、画像内に正確なテキストを表示する必要がある場面——従来から難しかったこのタスクをGPT Image 2は格段に改善して処理します。

4. ビジュアルQAタスク 参照画像を生成し、ビジョン機能を使って生成コンテンツが要件を満たしているかを検証する。

GPT Image 2 vs. AnyCap画像生成

GPT Image 2の直接統合と統合ケイパビリティレイヤーのどちらを選ぶか検討している開発者向け:

| 項目 | GPT Image 2 直接利用 | AnyCap(nano-banana + 各モデル) |

|---|---|---|

| 推論との統合 | ✅ ネイティブ | エージェントツールコール経由 |

| 1枚あたりのコスト | 高め | 大量生成では低コスト |

| モデルの多様性 | OpenAIのみ | 複数モデル対応 |

| APIの手軽さ | GPT-4oコンテキストが必要 | CLIコマンド1つ |

| 会話内での反復 | ✅ ネイティブ | 手動チェーニング |

実用的な推奨:画像生成が推論チェーンの一部となる推論重視のワークフローにはGPT Image 2を、大量生成やパイプライン自動化にはAnyCap経由の専用モデルを使用する。

今後の注目ポイント

GPT Image 2はまだ初期段階です。今後期待されること:

- モデルの成熟に伴う料金の変化

- 専用生成エンドポイント(チャットとは独立したもの)

- APIドキュメントの充実

- ファインチューニングオプションの可能性

この分野は注目し続ける価値があります——GPT Image 2は、画像生成がボルトオンの機能ではなく、ネイティブな推論能力へと移行するシフトを象徴しています。

AIエージェントで画像生成を始める

# AnyCap をインストールして統合画像生成アクセスを取得

curl -fsSL https://anycap.ai/install.sh | sh

# nano-banana-2 で画像生成(開発者向け最適化モデル)

anycap image generate \

--prompt "Developer dashboard UI mockup, dark theme" \

--model nano-banana-2 \

-o mockup.png

# または GPT ベースの画像解析

anycap image analyze mockup.png \

--prompt "What elements could be improved in this UI?"