O GPT Image 2 da OpenAI é a versão mais recente de sua capacidade de geração de imagens, agora integrada diretamente à família de modelos GPT-4o. Para desenvolvedores que acompanham a geração de imagens por IA em fluxos de trabalho com agentes, este é um avanço significativo — não porque seja necessariamente o melhor gerador de imagens, mas porque muda como a geração de imagens pode ser incorporada em pipelines de raciocínio de IA.

O que é o GPT Image 2?

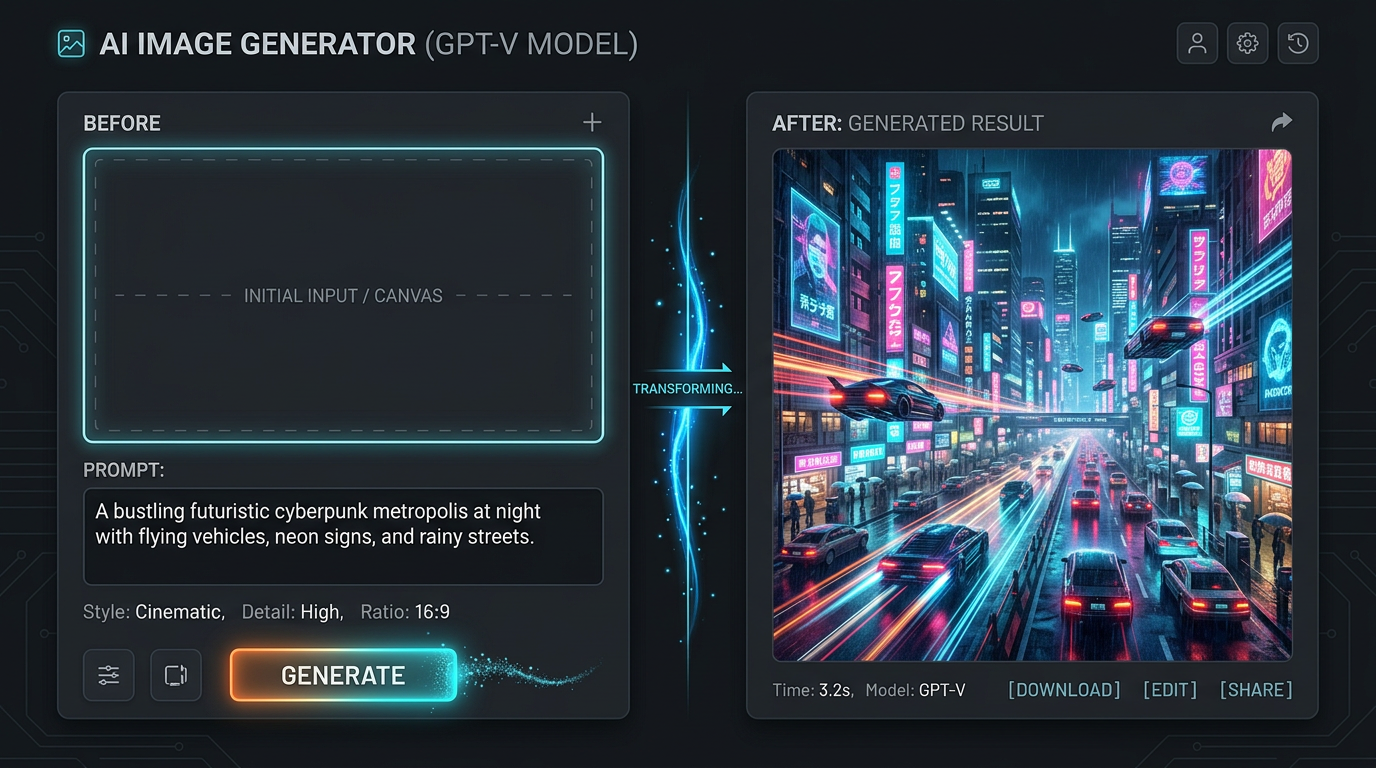

O GPT Image 2 é a capacidade multimodal de geração de imagens da OpenAI, integrada ao GPT-4o. Ao contrário do DALL-E 3 (que exigia uma chamada de API separada), o GPT Image 2 gera imagens de forma nativa dentro de uma conversa de chat ou API — o modelo pode raciocinar sobre a imagem, modificá-la com base em instruções subsequentes e integrar saídas visuais ao seu raciocínio.

Características principais:

- Multimodal nativo: Faz parte da conversa, não é uma chamada separada

- Seguimento de instruções: Lida com prompts complexos e detalhados com mais precisão do que as gerações anteriores

- Renderização de texto: Qualidade de texto em imagens significativamente melhorada (um ponto fraco de longa data)

- Edição: Suporta refinamento iterativo na mesma conversa

GPT Image 2 vs. Outros Modelos: Onde Ele se Posiciona

| Modelo | Pontos Fortes | Pontos Fracos |

|---|---|---|

| GPT Image 2 | Renderização de texto, seguimento de instruções, integração com raciocínio | Menor variedade artística, custo mais alto |

| Nano Banana 2 | Velocidade, API para desenvolvedores, estilos variados | Menor integração conversacional |

| Stable Diffusion (SDXL) | Fine-tuning, implantação local | Configuração complexa, seguimento de instruções limitado |

| Midjourney | Qualidade artística, saída estética | Sem API, não é amigável para desenvolvedores |

| Ideogram | Tipografia/texto em imagens | Casos de uso mais restritos |

A maior vantagem do GPT Image 2 é a integração com raciocínio: um agente GPT-4o pode gerar uma imagem, avaliá-la na mesma cadeia de raciocínio e decidir modificá-la ou seguir em frente — sem sair do contexto da conversa.

Acesso à API para Desenvolvedores

O GPT Image 2 está disponível pela API da OpenAI para usuários com acesso ao GPT-4o:

from openai import OpenAI

client = OpenAI()

# Gerar uma imagem via GPT Image 2

response = client.chat.completions.create(

model="gpt-4o",

messages=[{

"role": "user",

"content": "Generate an image of a minimal developer dashboard UI, dark theme, with metrics displayed"

}],

# A geração de imagens é tratada nativamente pelo modelo

)

Observação: Os parâmetros exatos da API para o GPT Image 2 ainda estão sendo documentados no momento desta publicação. Consulte o portal do desenvolvedor da OpenAI para obter as informações mais recentes.

Considerações sobre Preços

O GPT Image 2 é cobrado como parte do uso de tokens do GPT-4o, o que significa:

- As entradas de imagem custam tokens de entrada (com base no tamanho/nível de detalhe da imagem)

- As saídas de geração de imagem custam mais do que saídas de texto

- O custo por imagem é mais alto do que nas APIs de geração de imagem dedicadas

Regra geral: Para geração de imagens em grande volume em pipelines, modelos de imagem dedicados (nano-banana, Stable Diffusion) são mais econômicos. O valor do GPT Image 2 está em fluxos de trabalho de raciocínio onde a imagem faz parte de uma cadeia maior, não na geração em massa.

Casos de Uso em que o GPT Image 2 se Destaca

1. Geração de documentos e relatórios com visuais integrados Um agente que escreve um relatório E gera os gráficos/diagramas correspondentes, avaliando se eles representam os dados com precisão.

2. Prototipagem de UI com refinamento iterativo "Gere um design de formulário de login" → "Deixe o botão mais destacado" → "Adicione uma versão em modo escuro" — tudo em uma conversa, sem troca de contexto.

3. Conteúdo com requisitos precisos de texto Gráficos para redes sociais, slides ou materiais de marketing onde o texto precisa aparecer corretamente na imagem — uma tarefa historicamente difícil que o GPT Image 2 realiza significativamente melhor.

4. Tarefas de QA visual Gerar imagens de referência e, em seguida, usar visão computacional para verificar se o conteúdo gerado atende aos requisitos.

GPT Image 2 vs. Geração de Imagens AnyCap

Para desenvolvedores que escolhem entre a integração direta do GPT Image 2 e uma camada de capacidade unificada:

| Fator | GPT Image 2 Direto | AnyCap (nano-banana + modelos) |

|---|---|---|

| Integração com raciocínio | ✅ Nativo | Via chamadas de ferramenta do agente |

| Custo por imagem | Mais alto | Mais baixo para volume |

| Variedade de modelos | Somente OpenAI | Múltiplos modelos |

| Simplicidade da API | Requer contexto GPT-4o | Comando CLI único |

| Iteração na conversa | ✅ Nativo | Encadeamento manual |

A recomendação prática: use o GPT Image 2 para fluxos de trabalho intensivos em raciocínio onde a geração de imagens faz parte de uma cadeia; use modelos dedicados via AnyCap para geração em volume e automação de pipeline.

O que Acompanhar

O GPT Image 2 ainda está no início. Espere:

- Preços evoluindo conforme o modelo amadurece

- Endpoints de geração dedicados (separados do chat)

- Documentação de API aprimorada

- Possíveis opções de fine-tuning

Este é um espaço que vale a pena acompanhar de perto — o GPT Image 2 representa uma mudança em direção à geração de imagens como uma capacidade de raciocínio nativa, e não um complemento.

Começando com Geração de Imagens em Agentes de IA

# Instale o AnyCap para acesso unificado à geração de imagens

curl -fsSL https://anycap.ai/install.sh | sh

# Gere imagens com nano-banana-2 (modelo otimizado para desenvolvedores)

anycap image generate \

--prompt "Developer dashboard UI mockup, dark theme" \

--model nano-banana-2 \

-o mockup.png

# Ou com compreensão de imagem baseada em GPT

anycap image analyze mockup.png \

--prompt "What elements could be improved in this UI?"

→ Capacidade de Geração de Imagens → Comparar Modelos de Geração de Imagens