OpenAIs GPT Image 2 ist die neueste Generation ihrer Bildgenerierungsfähigkeit, jetzt direkt in die GPT-4o-Modellfamilie integriert. Für Entwickler, die KI-Bildgenerierung für Agenten-Workflows im Blick haben, ist dies eine bedeutsame Entwicklung — nicht weil es zwingend der beste Bildgenerator ist, sondern weil es verändert, wie Bildgenerierung in KI-Reasoning-Pipelines eingebettet werden kann.

Was ist GPT Image 2?

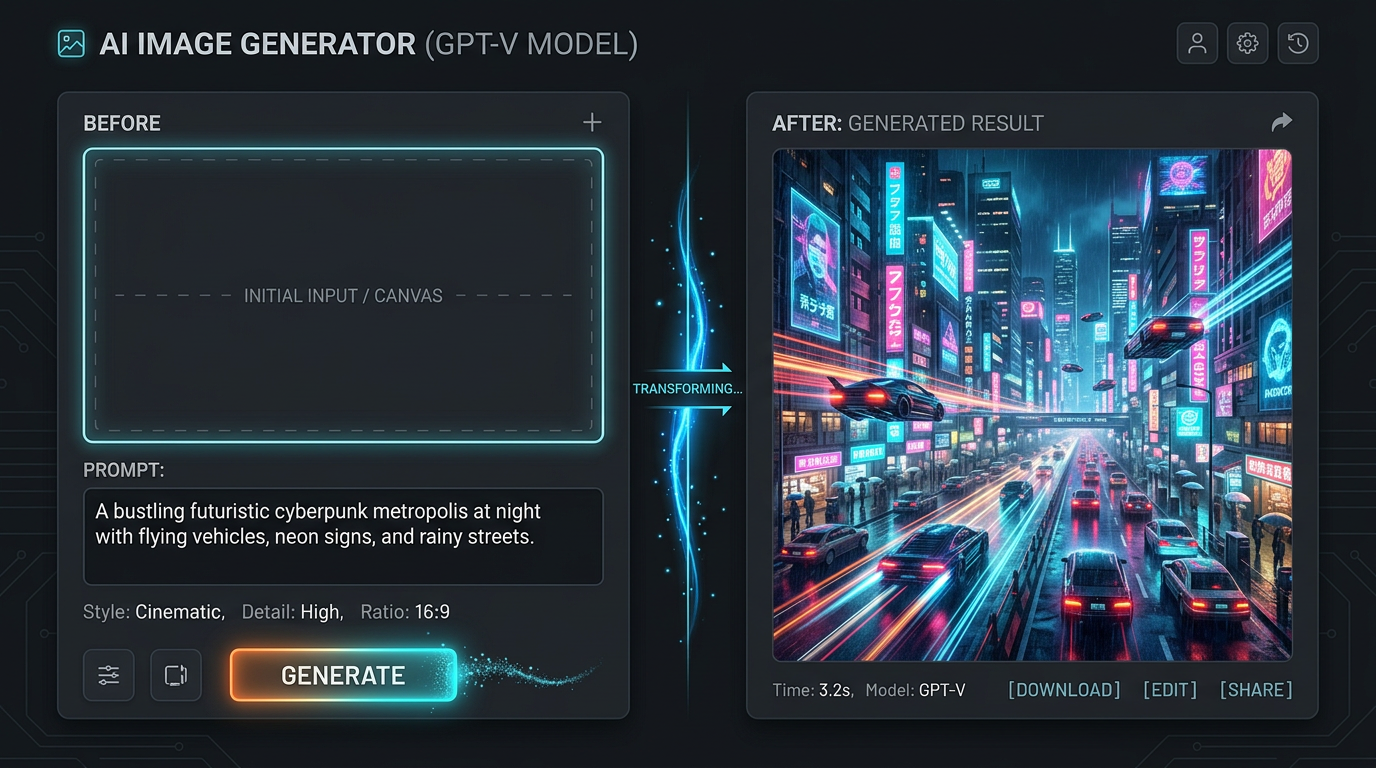

GPT Image 2 ist OpenAIs multimodale Bildgenerierungsfähigkeit, die in GPT-4o integriert ist. Anders als DALL-E 3 (das einen separaten API-Aufruf erforderte) generiert GPT Image 2 Bilder nativ innerhalb eines Chat- oder API-Gesprächs — das Modell kann über das Bild nachdenken, es auf Basis von Folgeanweisungen anpassen und visuelle Ausgaben in sein Reasoning integrieren.

Wesentliche Merkmale:

- Nativ multimodal: Teil des Gesprächs, kein separater Aufruf

- Instruktionstreue: Verarbeitet komplexe, detaillierte Prompts deutlich genauer als frühere Generationen

- Textwiedergabe: Deutlich verbesserte Textqualität in Bildern (eine langjährige Schwachstelle)

- Bearbeitung: Unterstützt iterative Verfeinerung im selben Gespräch

GPT Image 2 vs. andere Modelle: Wo es steht

| Modell | Stärken | Schwächen |

|---|---|---|

| GPT Image 2 | Textwiedergabe, Instruktionstreue, Reasoning-Integration | Weniger künstlerische Bandbreite, höhere Kosten |

| Nano Banana 2 | Geschwindigkeit, Entwickler-API, vielfältige Stile | Weniger konversationelle Integration |

| Stable Diffusion (SDXL) | Feintuning, lokaler Einsatz | Komplexes Setup, weniger Instruktionstreue |

| Midjourney | Künstlerische Qualität, ästhetische Ausgaben | Keine API, nicht entwicklerfreundlich |

| Ideogram | Typografie/Text in Bildern | Engere Anwendungsfälle |

GPT Image 2s stärkster Vorteil ist die Reasoning-Integration: Ein GPT-4o-Agent kann ein Bild generieren, es in derselben Reasoning-Kette auswerten und entscheiden, ob er es anpasst oder damit weiterarbeitet — ohne den Gesprächskontext zu verlassen.

API-Zugang für Entwickler

GPT Image 2 ist über die OpenAI API für Nutzer mit GPT-4o-Zugang verfügbar:

from openai import OpenAI

client = OpenAI()

# Bild über GPT Image 2 generieren

response = client.chat.completions.create(

model="gpt-4o",

messages=[{

"role": "user",

"content": "Generate an image of a minimal developer dashboard UI, dark theme, with metrics displayed"

}],

# Bildgenerierung wird nativ vom Modell übernommen

)

Hinweis: Die genauen API-Parameter für GPT Image 2 werden zum Zeitpunkt dieser Veröffentlichung noch dokumentiert. Die aktuellen Informationen finden Sie im OpenAI Developer Portal.

Überlegungen zur Preisgestaltung

GPT Image 2 wird als Teil der GPT-4o Token-Nutzung abgerechnet, was bedeutet:

- Bildeingaben kosten Input-Token (abhängig von Bildgröße/Detailgrad)

- Bildgenerierungs-Ausgaben kosten mehr als Textausgaben

- Die genauen Kosten pro Bild sind höher als bei spezialisierten Bildgenerierungs-APIs

Faustregel: Für hochvolumige Bildgenerierung in Pipelines sind dedizierte Bildmodelle (nano-banana, Stable Diffusion) kostengünstiger. Der Mehrwert von GPT Image 2 liegt in Reasoning-Workflows, bei denen das Bild Teil einer größeren Kette ist — nicht bei der Massenproduktion.

Anwendungsfälle, in denen GPT Image 2 glänzt

1. Dokument- und Berichtserstellung mit eingebetteten Visualisierungen Ein Agent, der einen Bericht schreibt UND die passenden Diagramme generiert, und dabei prüft, ob sie die Daten korrekt darstellen.

2. UI-Prototyping mit iterativer Verfeinerung „Generiere ein Login-Formular-Design" → „Mache den Button prominenter" → „Füge eine Dark-Mode-Version hinzu" — alles in einem Gespräch, ohne Kontextwechsel.

3. Inhalte mit präzisen Textanforderungen Social-Media-Grafiken, Präsentationen oder Marketingmaterialien, bei denen Text korrekt im Bild erscheinen muss — eine historisch schwierige Aufgabe, die GPT Image 2 deutlich besser bewältigt.

4. Visuelle QA-Aufgaben Referenzbilder generieren und dann mithilfe von Vision prüfen, ob generierte Inhalte den Anforderungen entsprechen.

GPT Image 2 vs. AnyCap-Bildgenerierung

Für Entwickler, die zwischen direkter GPT Image 2-Integration und einer einheitlichen Capability-Schicht wählen:

| Faktor | GPT Image 2 direkt | AnyCap (nano-banana + Modelle) |

|---|---|---|

| Reasoning-Integration | ✅ Nativ | Über Agent-Tool-Calls |

| Kosten pro Bild | Höher | Günstiger für großes Volumen |

| Modellvielfalt | Nur OpenAI | Mehrere Modelle |

| API-Einfachheit | Erfordert GPT-4o-Kontext | Einzelner CLI-Befehl |

| Iteration im Gespräch | ✅ Nativ | Manuelles Verketten |

Die praktische Empfehlung: GPT Image 2 für reasoning-intensive Workflows, bei denen Bildgenerierung Teil einer Kette ist; dedizierte Modelle über AnyCap für Volumenproduktion und Pipeline-Automatisierung.

Was zu beobachten ist

GPT Image 2 steckt noch in den Anfängen. Zu erwarten sind:

- Preisanpassungen mit zunehmender Reife des Modells

- Dedizierte Generierungs-Endpoints (getrennt vom Chat)

- Verbesserte API-Dokumentation

- Mögliche Feintuning-Optionen

Dieses Feld ist es wert, genau beobachtet zu werden — GPT Image 2 steht für einen Wandel hin zur Bildgenerierung als nativem Reasoning-Feature statt als nachträglicher Ergänzung.

Erste Schritte mit Bildgenerierung in KI-Agenten

# AnyCap für einheitlichen Bildgenerierungs-Zugang installieren

curl -fsSL https://anycap.ai/install.sh | sh

# Bilder mit nano-banana-2 generieren (entwickleroptimiertes Modell)

anycap image generate \

--prompt "Developer dashboard UI mockup, dark theme" \

--model nano-banana-2 \

-o mockup.png

# Oder mit GPT-basiertem Bildverständnis

anycap image analyze mockup.png \

--prompt "What elements could be improved in this UI?"

→ Bildgenerierungs-Capability → Bildgenerierungsmodelle vergleichen